¿Alguna vez has sentido que, tras una respuesta perfecta de Google o ChatGPT, tu cerebro simplemente se apaga? Esa satisfacción inmediata es, en realidad, un cementerio cognitivo. El aprendizaje invisible no es lo que te enseñan, sino lo que tu mente construye mientras navega por la incertidumbre. Cuando sustituimos la instrucción directa por la interrogación socrática mediada por IA, el cerebro deja de ser un almacén de datos para convertirse en un laboratorio de conexiones sinápticas.

¿Qué es el Aprendizaje Invisible en la era de la IA?

La educación tradicional se ha obsesionado con el «qué». Sin embargo, la neurociencia moderna sugiere que el «cómo preguntamos» altera físicamente nuestra arquitectura cerebral. Según un estudio de la Universidad de California, la curiosidad prepara al cerebro para aprender y recordar incluso información aburrida. ¿Estamos usando la IA para alimentar esa curiosidad o para dopar nuestra pereza intelectual?

Al interactuar con modelos de lenguaje, solemos buscar la eficiencia. Pero la eficiencia es la enemiga del pensamiento profundo. Si la máquina te da el resultado, tu metacognición se detiene. ¿Es posible que el verdadero valor de un prompt no resida en la calidad de la respuesta generada, sino en la tensión intelectual que nos obliga a mantener el diálogo?

Neurociencia de la curiosidad vs. Instrucción Directa

Cuando un docente —o un chatbot— te explica un concepto de forma lineal, tu cerebro opera en un estado de baja resistencia. No hay conflicto. No hay drama. En cambio, el maestro inútil es aquel que desaparece para dejar que el alumno aparezca. El aprendizaje invisible florece en ese vacío.

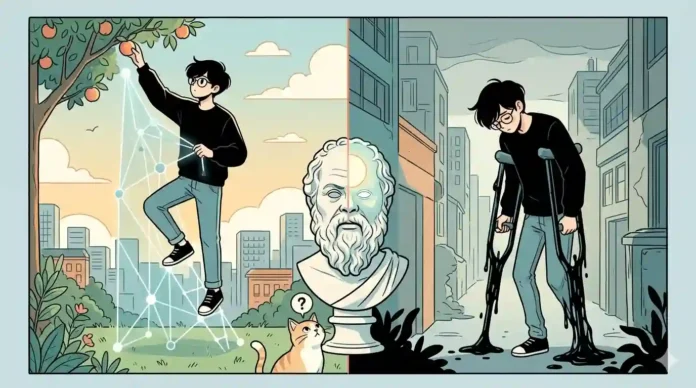

Datos técnicos indican que el aprendizaje basado en problemas (PBL) incrementa la retención de conceptos hasta en un 40% comparado con las clases magistrales. Si aplicamos esto a la ingeniería de prompts, el objetivo cambia: ya no queremos que la IA sea un oráculo, sino un andamiaje socrático. ¿Estamos programando respuestas o simplemente enterrando la capacidad de asombro bajo una montaña de texto predictivo?

El Diálogo Socrático con Modelos de Lenguaje

La mayoría de los usuarios sufren de la falacia de la IA neutra. Creen que la máquina posee la verdad. Un enfoque socrático rompe este espejo. En lugar de pedirle a Gemini que resuelva una ecuación, pídele que cuestione tu lógica. ¿Dónde falla tu argumento? ¿Qué premisas estás dando por sentadas?

Este cambio de paradigma requiere lo que denominamos red teaming pedagógico: hackear nuestra propia forma de aprender. No es la IA la que debe aprender de nosotros mediante el entrenamiento, somos nosotros quienes debemos desaprender la obediencia al dato para reaprender el arte de la duda. ¿Qué pasaría si la medida del éxito de una sesión de chat no fuera la solución encontrada, sino la calidad de la nueva pregunta que ha surgido?

Preguntas Frecuentes (FAQ) sobre Aprendizaje Invisible e IA

1. ¿Por qué es mejor una pregunta que una respuesta rápida?

Porque la respuesta rápida cierra el ciclo cognitivo, mientras que la pregunta lo mantiene abierto. Según la Teoría de la Brecha de Información de George Loewenstein, la curiosidad es un estado de privación que solo se alivia con el descubrimiento activo, lo cual genera un aprendizaje mucho más profundo.

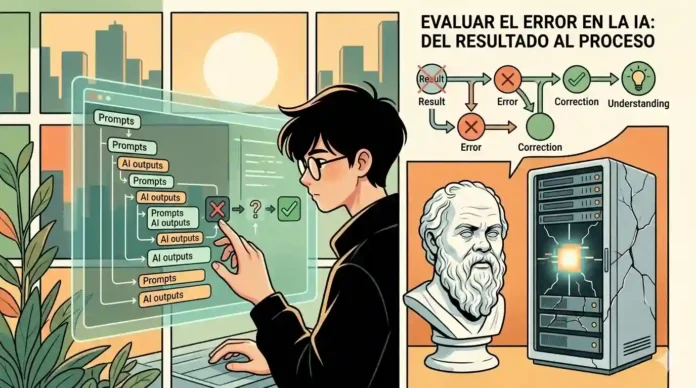

2. ¿Cómo puedo configurar una IA para que sea socrática?

Utiliza un «System Prompt» que le ordene no dar soluciones. Ejemplo: «Actúa como un tutor socrático. Nunca me des la respuesta. Analiza mis errores y devuélveme una pregunta que me ayude a ver mi propia contradicción.» Puedes ver más ejemplos en nuestra guía sobre el prompt maestro.

3. ¿El aprendizaje invisible es aplicable a todas las áreas?

Absolutamente. Desde las matemáticas hasta la ética. La clave es el constructivismo digital: construir conocimiento usando la IA como espejo, no como fuente única. Para profundizar en esto, recomendamos los trabajos de MIT Media Lab sobre el aprendizaje creativo.

El conocimiento que no se pelea, se olvida. La IA nos ha dado acceso a toda la información del mundo, pero nos está robando el esfuerzo necesario para procesarla. ¿Estás dispuesto a dejar de ser un consumidor de respuestas para convertirte en un arquitecto de dudas?

¿Te atreverías a pedirle hoy a tu IA que no te dé la razón, sino que destruya tu argumento más sólido?

Para seguir explorando esta dialéctica, te invito a leer sobre cómo la paradoja de la alucinación puede ser, en realidad, un espejo de nuestra propia ignorancia.