La mayoría de los usuarios interactúan con modelos de lenguaje como si fueran calculadoras lógicas. Introducen premisas, esperan una conclusión necesaria y llaman a eso «inteligencia». Sin embargo, esta obsesión con la deducción limita el potencial del diálogo hombre-máquina. ¿Qué ocurre cuando los datos no bastan? ¿Qué sucede cuando la respuesta no está en el dataset, sino en la intuición de lo posible?

La tiranía de la deducción en el prompting actual

Solemos pedirle a la IA que razone como Sherlock Holmes, asumiendo que el detective era puramente deductivo. Error. Holmes era un maestro de la abducción. La deducción es segura, pero estéril; no añade información nueva, solo reorganiza la existente. Si le pides a un LLM que resuelva un problema siguiendo un manual, estás usando un martillo de oro para clavar un clavo de madera.

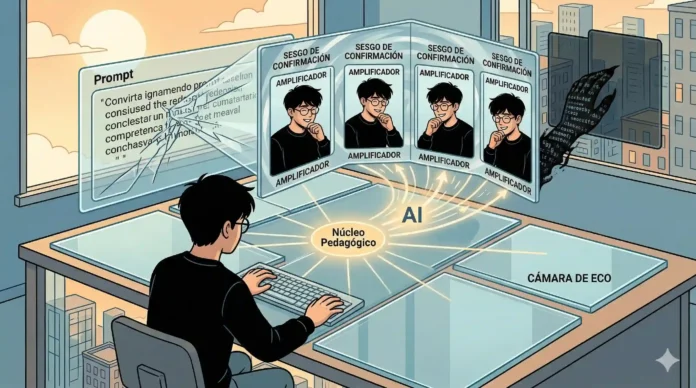

Charles Sanders Peirce, padre del pragmatismo, sostenía que la abducción es la única operación lógica que introduce ideas nuevas. En un experimento de la Universidad de Stanford, se observó que los modelos de lenguaje tienden a «alucinar» más cuando se les fuerza a deducir sobre hechos inexistentes que cuando se les invita a teorizar sobre hipótesis posibles. ¿Estamos ante un fallo de la máquina o un reflejo de nuestra propia ignorancia al no saber qué preguntar?

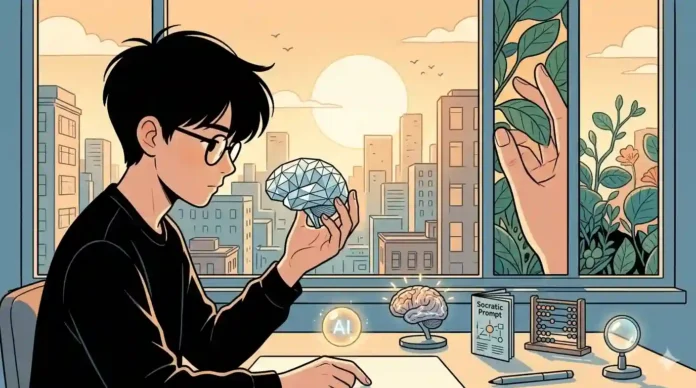

Abducción: El arte de la conjetura inteligente

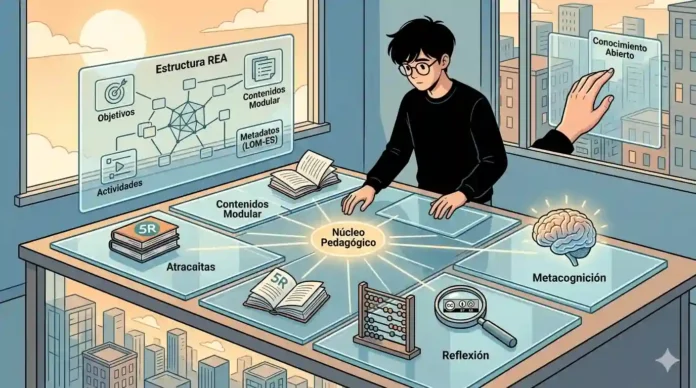

Imagínate frente a una anomalía en tu negocio. Los datos dicen que las ventas caen, pero no explican el «alma» del problema. La deducción te daría estadísticas. La abducción te daría escenarios. Al solicitar un razonamiento abductivo, obligas a la IA a actuar como un filósofo de la ciencia, no como un contable. Es la diferencia entre preguntar «¿Qué dice el informe?» y «¿Qué historia coherente explica estos silencios en el informe?».

Este enfoque combate la entropía del razonamiento, esa tendencia a aceptar la primera respuesta genérica que nos escupe el chat. Según la American Philosophical Association, el pensamiento crítico no reside en encontrar la respuesta correcta, sino en evaluar la solidez de una inferencia ante la falta de evidencia. ¿Es posible que, al buscar certezas, estemos atrofiando nuestra capacidad de imaginar causas?

Cómo hackear el dataset: Razonar sobre lo que no está

La IA no «sabe» nada, pero «conecta» todo. La abducción aprovecha esa arquitectura latente para iluminar puntos ciegos. Si aplicamos la inferencia inversa, podemos descubrir sesgos que ni siquiera sabíamos que teníamos. Es un ejercicio de mayéutica pura: usar la máquina para parir una verdad que no estaba en el prompt inicial.

Prueba este cambio de paradigma:

- Deductivo: «Analiza estos datos y dime la conclusión.» (Resultado: Obvio).

- Abductivo: «Estos datos presentan una inconsistencia X. Propón tres hipótesis disruptivas que expliquen este fenómeno, asumiendo que la causa es un factor externo no mencionado.» (Resultado: Insight).

¿No es acaso el juicio crítico la última frontera que nos separa del algoritmo? Si dejamos que la IA solo deduzca, solo estamos automatizando el pasado. Si la usamos para la abducción, estamos colonizando el futuro.

Preguntas Frecuentes (FAQ)

¿La abducción aumenta las alucinaciones?

Si no se acota, sí. La clave es pedir a la IA que califique la probabilidad de sus propias hipótesis. Puedes consultar más sobre la ética de estas inferencias en la Stanford Encyclopedia of Philosophy.

¿Qué modelos son mejores para la abducción?

Modelos con mayor capacidad de razonamiento sistémico como GPT-4o o Claude 3.5 Sonnet tienden a manejar mejor las conexiones interdisciplinarias necesarias para una buena conjetura. Mira este análisis técnico en arXiv.org sobre razonamiento simbólico.

¿Puedo usar esto para el aprendizaje?

Absolutamente. Es la base de la pedagogía constructivista. No le des el resultado al alumno; dale el enigma y que use la IA para abducir la regla.

Para profundizar en la lógica del descubrimiento, recomiendo revisar los trabajos sobre el método científico en la Encyclopedia Britannica. ¿Estás listo para dejar de pedir respuestas y empezar a pedir hipótesis?