La Evaluación del Error: ¿Por qué premiamos la respuesta correcta en la era de la IA?

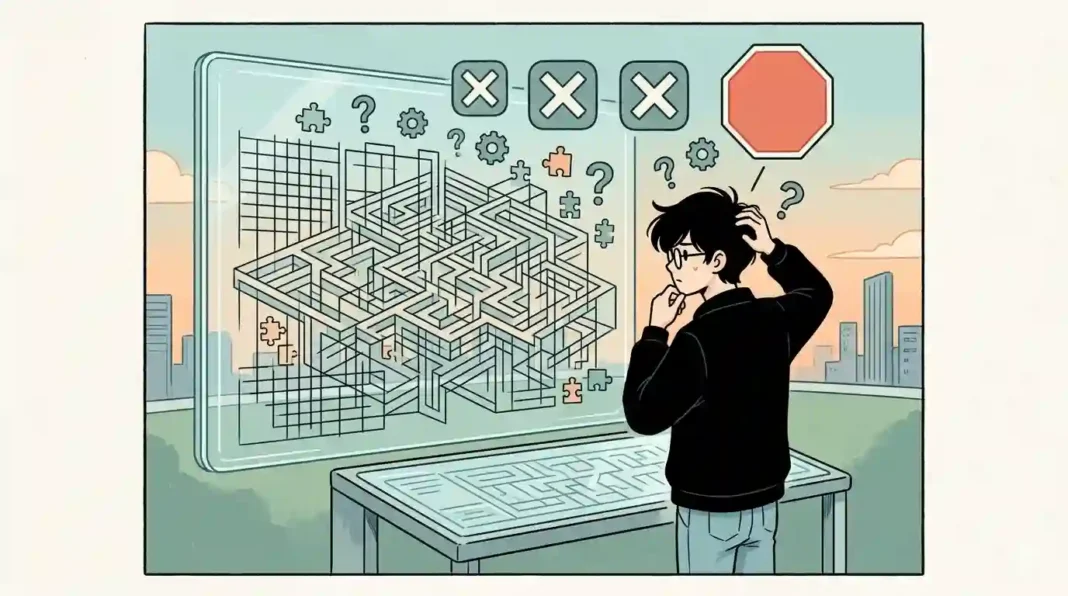

Obsesionarse con la respuesta correcta hoy es, paradójicamente, una forma de obsolescencia. Si un Large Language Model (LLM) puede escupir un ensayo sobre termodinámica en seis segundos, ¿qué valor tiene que un alumno entregue exactamente lo mismo? Ninguno. Hemos llegado a un punto de ruptura donde la perfección técnica es una mercancía barata.

La verdadera inteligencia ya no reside en el dato final, sino en las cicatrices del proceso. ¿Y si el error fuera el único rastro de humanidad que nos queda frente a la máquina?

¿Por qué la respuesta perfecta es el fin del aprendizaje?

Entregar un trabajo impecable gracias a un prompt de una sola línea es una victoria vacía. Un estudio de la Universidad de Oxford sugiere que la externalización del juicio crítico a sistemas automatizados reduce la retención de conceptos a largo plazo en un 30%. ¿Estamos educando expertos o simplemente gestores de copiar y pegar?

Cuando un estudiante corrige una alucinación de la IA, está demostrando un dominio superior al que simplemente acepta la verdad estadística del algoritmo. El error no es un fallo en el sistema; es el mapa de la comprensión.

La Mayéutica del Error: Evaluar la duda, no la certeza

¿Qué pasaría si la calificación dependiera de los tachones digitales? En el arte de desaparecer como maestros, debemos obligar al alumno a aparecer a través de su disconformidad. No busques la armonía con la IA; busca la fricción.

Imagina una rúbrica que premie estos tres puntos:

- Detección de inconsistencias: Encontrar dónde la IA simplificó demasiado el problema.

- Refinamiento de la pregunta: Cómo el alumno usó la inferencia inversa para llegar al fondo del asunto.

- Defensa del error propio: Explicar por qué una premisa inicial era errónea tras contrastarla con la lógica del modelo.

«La duda es el principio de la sabiduría», decía Aristóteles. En 2026, la duda es la última defensa ante la entropía del razonamiento.

Comparativa: Evaluación Tradicional vs. Evaluación Socrática-IA

| Criterio | Evaluación Tradicional | Evaluación del Error (Socrática) |

|---|---|---|

| Objetivo | Precisión del resultado final. | Calidad del proceso de refinamiento. |

| Rol del Alumno | Almacén de respuestas. | Arquitecto de preguntas e inquisidor. |

| Uso de IA | Prohibido o ignorado. | Espejo dialéctico y catalizador de dudas. |

| Valor del Error | Penalización directa. | Evidencia de pensamiento activo. |

Hacia una pedagogía de la desconfianza productiva

Si seguimos premiando la respuesta correcta, estamos entrenando a nuestros jóvenes para competir contra una calculadora de billones de parámetros. Es una batalla perdida. Sin embargo, si premiamos la capacidad de desmontar esa respuesta, de encontrar el hilo suelto en el tejido de la IA, estamos cultivando el pensamiento crítico como frontera final.

¿No es acaso más revelador un alumno que explica por qué la IA se equivoca que uno que entrega un diez perfecto sin saber cómo llegó a él? ¿Estamos evaluando mentes o simplemente certificando el buen funcionamiento del software de OpenAI o Google?

Preguntas Frecuentes (FAQ)

¿Cómo implementar esto en el aula mañana mismo?

Pide a tus alumnos que traigan una respuesta de ChatGPT sobre un tema complejo y que escriban tres razones por las cuales esa respuesta es insuficiente o sesgada. Consulta guías de UNESCO sobre IA y Educación para más marcos éticos.

¿No es más difícil corregir procesos que resultados?

Sí. Requiere que el evaluador también sea un pensador. Pero, ¿preferimos la comodidad de una corrección automática o la profundidad de una mente que despierta?

Para profundizar en cómo la tecnología afecta nuestra mente, recomiendo visitar Wired o explorar la documentación de OpenAI Research sobre el comportamiento de los modelos.