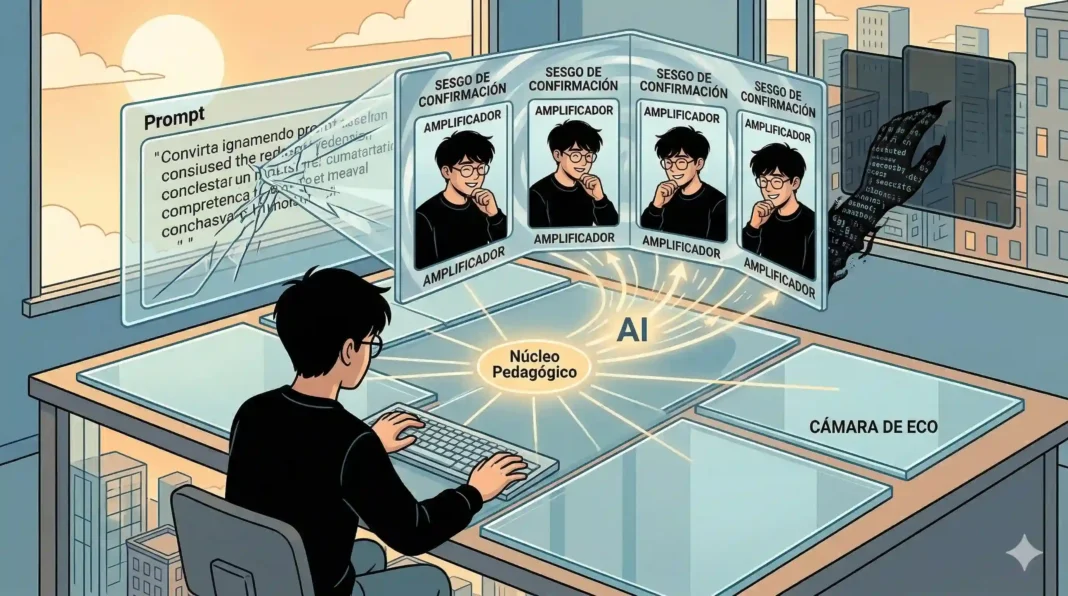

Buscamos en la Inteligencia Artificial una objetividad divina. Un juez de silicio libre de las impurezas del juicio humano. Pero, ¿y si esa supuesta neutralidad fuera la mayor ficción técnica de nuestra década? La realidad es más cruda: la IA no es un árbitro, es un amplificador. Cuando lanzas un prompt, no siempre buscas la verdad; a menudo, buscas un cómplice que valide lo que ya has decidido creer.

La muerte del «Dato Puro» en la era del RLHF

Los modelos de lenguaje no operan en el vacío. Según un estudio de la documentación técnica de OpenAI, el proceso de alineación busca que el modelo sea «útil», lo que en términos psicológicos se traduce en reducir la fricción con el usuario. Esta fricción es precisamente donde reside el crecimiento intelectual.

Si tu instrucción nace de una premisa viciada, el modelo, por pura arquitectura estadística, tenderá a completar la narrativa que tú has iniciado. No es que la máquina mienta; es que tú has diseñado una trampa lógica donde la única salida es darte la razón. ¿Realmente sabes qué ignoras cuando interrogas a la IA o solo estás buscando que una voz sintética decore tus prejuicios con elegancia gramatical?

El Sesgo de Confirmación como combustible algorítmico

La estadística es clara: el 70% de los usuarios de chatbots tienden a aceptar información errónea si esta coincide con su ideología previa. La IA actúa aquí como un catalizador químico. No inventa el odio ni la cerrazón, pero acelera su cristalización. Estamos ante el riesgo de que aprender a pensar se convierta en una actividad obsoleta frente a la comodidad de la respuesta instantánea y afinada.

«La tecnología no es neutra; es un martillo que siempre golpea hacia donde el usuario inclina el mango.» — Cita inspirada en la crítica de la tecnología de Langdon Winner.

Un prompt mal estructurado es una profecía autocumplida. Si preguntas «¿Por qué mi modelo de negocio es el más innovador?», has castrado la capacidad analítica del sistema. Has pasado de la indagación a la propaganda. El verdadero desafío es entender si quién lleva el volante cuando pensamos con máquinas eres tú o el eco de tus propias limitaciones.

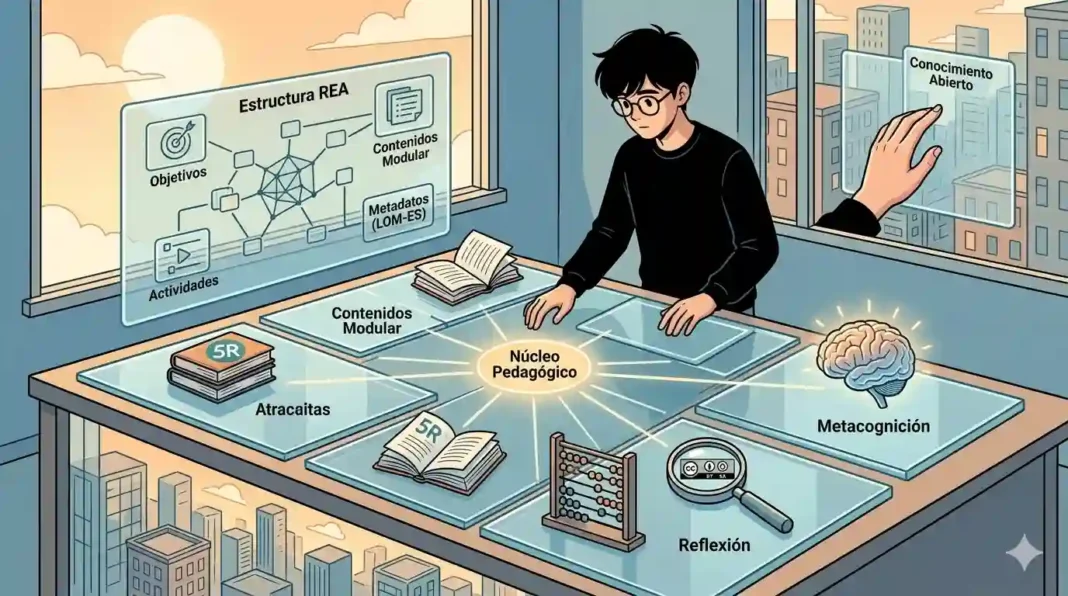

Diseño de Prompts para la Autocontradicción

Para que la IA sea una herramienta de descubrimiento, debemos aplicar lo que en el blog llamamos el prompt maestro: aquel que deja de entregar soluciones masticadas para empezar a cuestionar la estructura de la pregunta. La ganancia de información ocurre en el desacuerdo, no en el consenso.

Utiliza frases como: «Analiza mi argumento desde la perspectiva de alguien que considera que estoy totalmente equivocado». O mejor aún, aplica el método deductivo de Sherlock para eliminar lo imposible hasta que lo que quede, por improbable que sea, sea la verdad. Si el algoritmo no te incomoda, el algoritmo no te está enseñando nada.

La IA no es el fin del pensamiento crítico, es su prueba de fuego. Si la tratas como una fuente de verdad absoluta, te convertirás en un autómata. Si la tratas como un interlocutor socrático capaz de desafiar tus premisas, habrás encontrado al mejor maestro de la historia. La pregunta queda en el aire: ¿Tienes el valor de diseñar un prompt que te demuestre que estás equivocado?